11 图神经网络 GCN

我们前面通过多层感知机处理表格数据, 用 CNN 处理图像数据, 用 RNN 处理序列数据. 如果我们要探索图结构的数据 (例如交通路网中不同节点的流量预测) 这样的位置关系, 则需要使用图网络.

1 图卷积网络 GCN

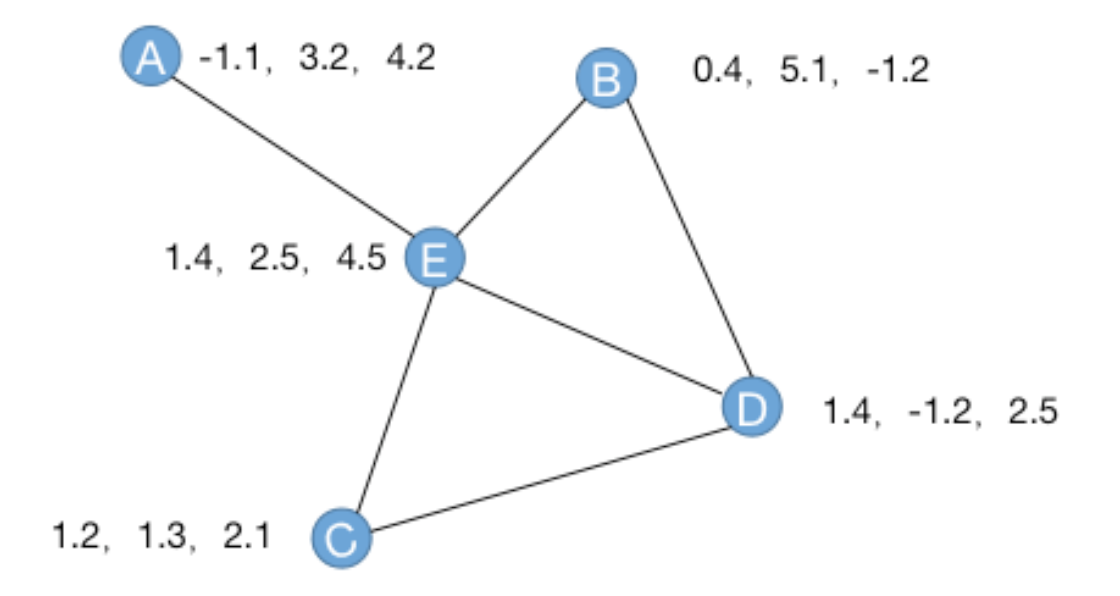

1.1 邻接矩阵

设输入为

经过邻接矩阵后变为:

这里我们发现,

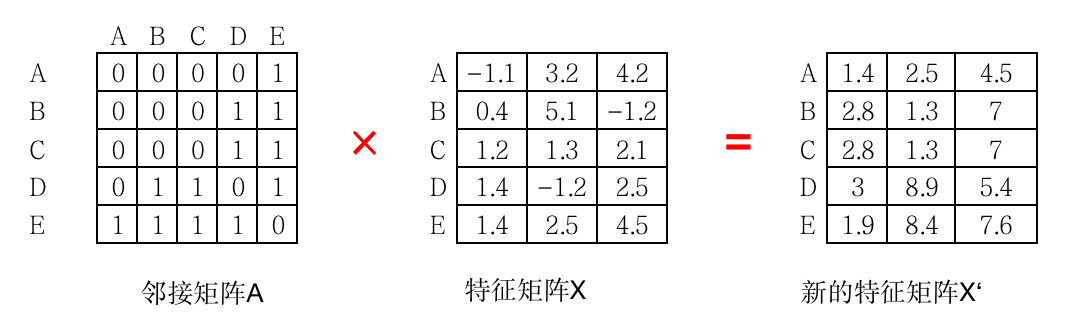

1.2 求平均

上述求和会改变特征的量级. 为此, 需要首先求和得到度矩阵, 也就是邻接矩阵每一行的求和得到的对角阵:

进一步地考虑自身信息,

最后求平均的操作变为

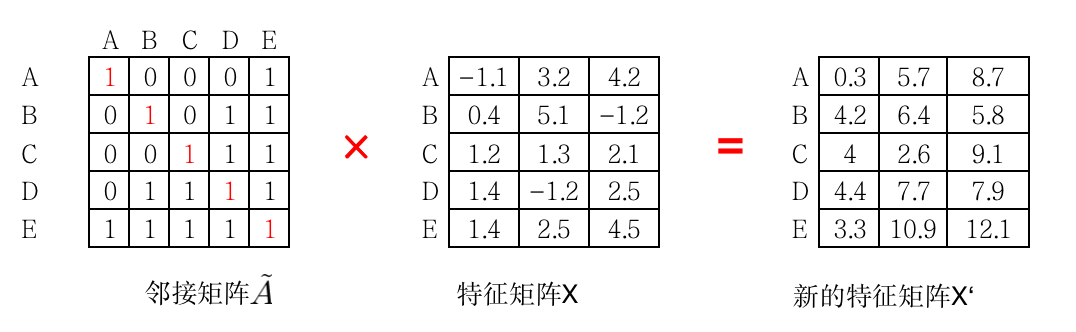

1.3 Renormalization

上述方式依然有些不合理, 因为这样节点的特征会被周围节点显著影响. 修改为

这样同时考虑了行和列变换, 同时考虑到了两个节点自身的度. 因此如果一个小特征节点连着一个大特征节点, 且大特征节点度很大, 则它也不会把很多特征分配给小节点了.

综上, 下一层的特征就是上一层特征的图卷积

这本质上依然是线性神经网络!